苹果电脑Macbook/Mac mini本地快速部署DeepSeek指南

本文为苹果电脑Macbook/ Mac mini本地快速部署DeepSeek的指南,让Mac小白也能真正的快速上手实践。

总体步骤

- 1.下载Ollama并安装运行DeepSeek

- 2.下载Chatbox并配置为本地DeepSeek

- 3.开启DeepSeek本地交互(无需联网)

一、下载Ollama并安装运行DeepSeek

1、从Ollama官方网站下载Ollama:

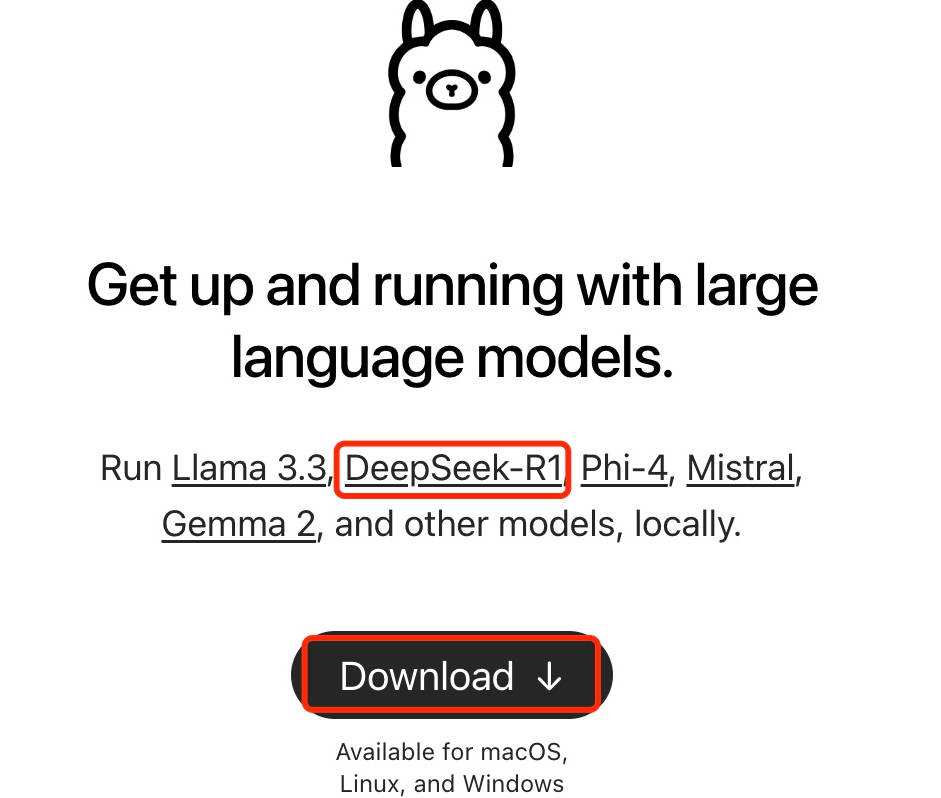

进入Ollama官方网站后,可以看到Ollama已经支持DeepSeek-R1的部署:

2、点击DeepSeek-R1的链接可以看到有关deepseek-r1的详细介绍:

目前deepseek-r1模型大小提供了7个选择:1.5b、7b、8b、14b、32b、70b、671b。

如果你的Mac内存配置较低(8G内存),建议选择最小的1.5b模型,如果是16G内存,建议选择7B或8B模型,模型选择原则:内存>模型标号

通常模型大小(参数量)越大,模型的理解和生成能力越强,但也会消耗更多的计算资源。至于671B的完全体就不要想了,mac没那么大内存可以跑起来

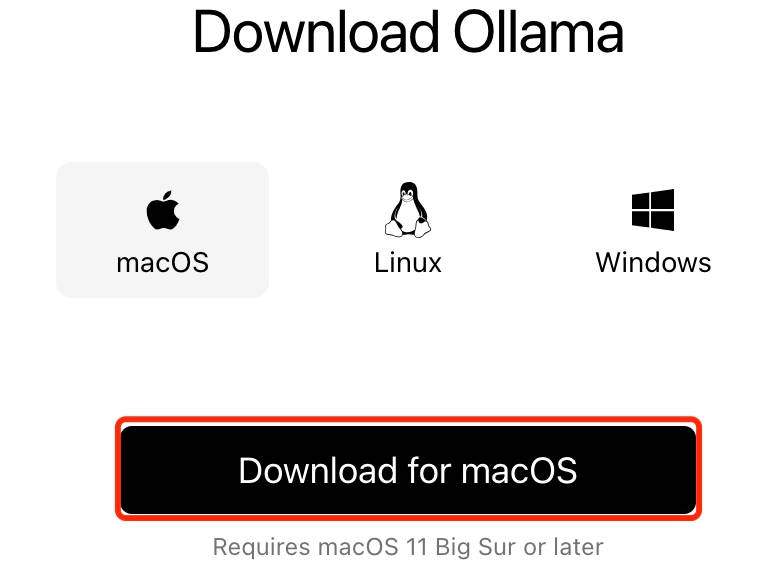

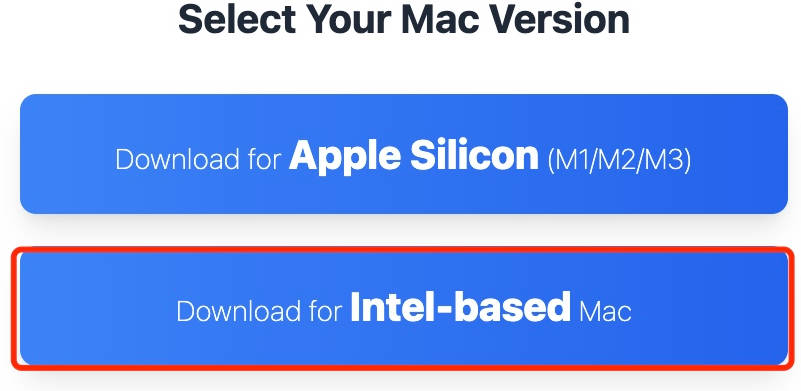

3、点击Download按钮下载符合自己平台的Ollama:

这里选择macOS,点击下载。

下载文件大小不到200M,文件名为:Ollama-darwin.zip。

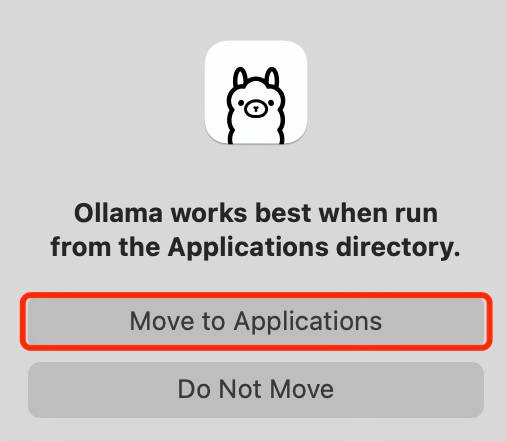

4、解压后打开Ollama应用程序,点击next,点击Install安装ollama。

5、按照提示,打开终端,使用 Command + Space 快捷键调用 terminal:

在终端窗口运行下面命令:

ollama run deepseek-r1:8b

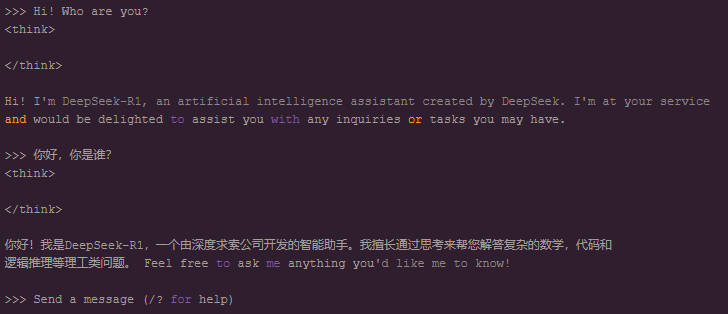

6、下载完毕的话,在终端中就直接可以和DeepSeek对话了:

二、下载Chatbox并配置为本地DeepSeek

1、打开Chatbox官方网站:https://chatboxai.app/en

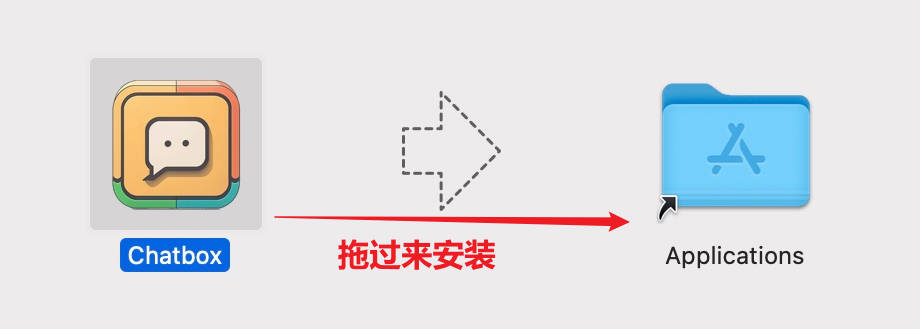

2、下载的Chatbox-1.9.7.dmg,大小100M多点,点击安装,按下面提示拖到Applications内:

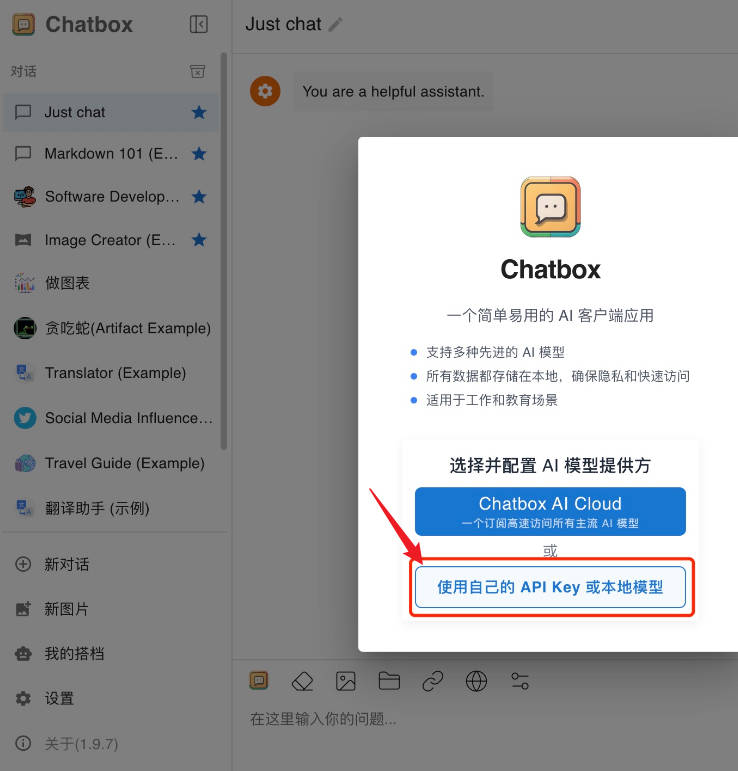

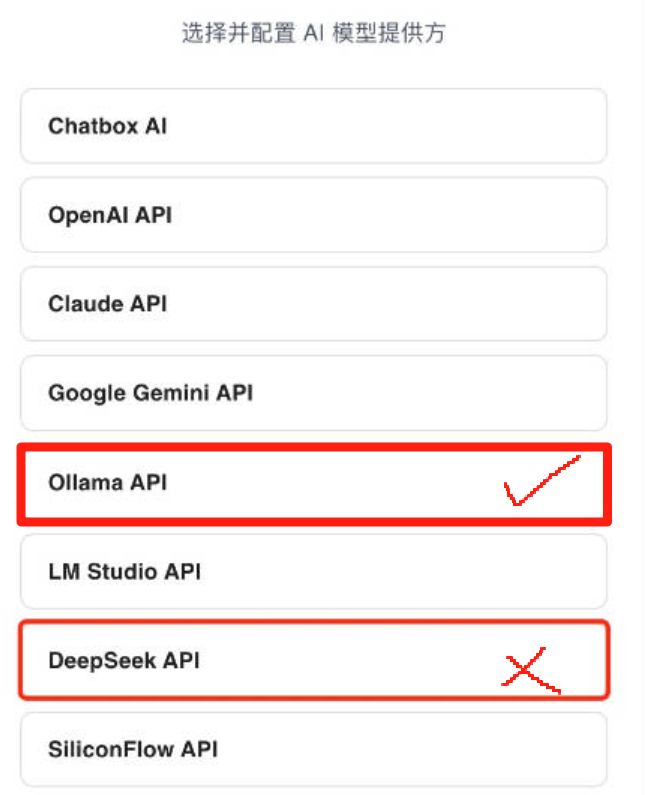

3、注意,这里不能选择DeepSeek API,这小白经常会选错的,实际上,若选择这个你就找不到你本地的DeepSeek模型。

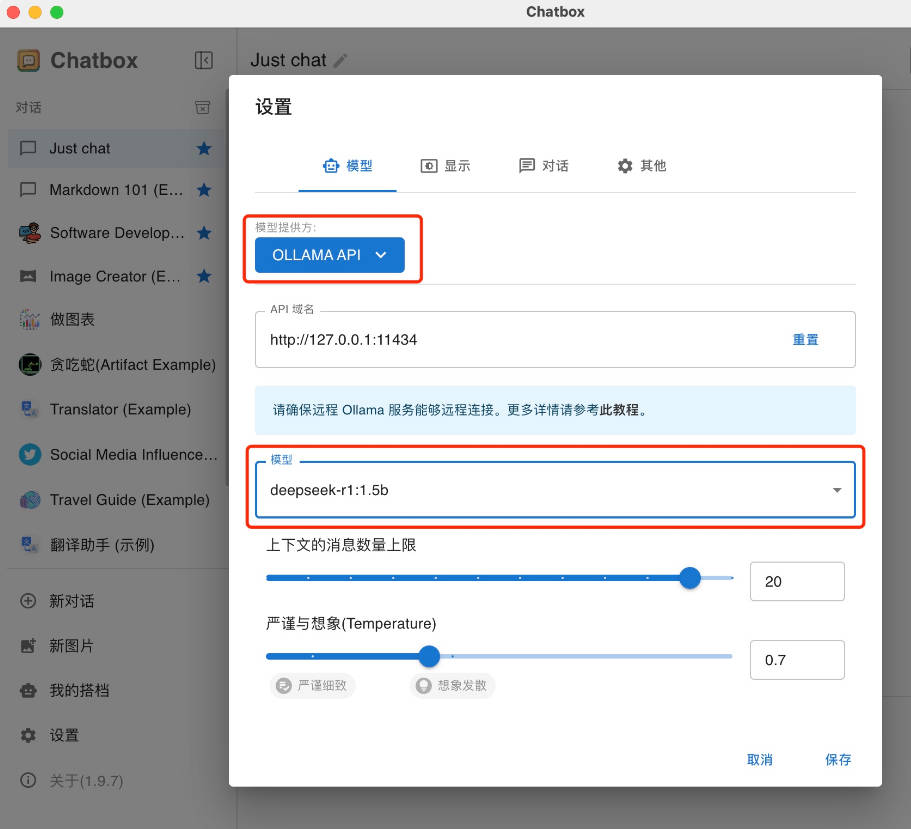

正确的应该选择OLLAMA API,然后就可以看到我们上一步安装好的deepseek-r1:8b或其他参数的模型

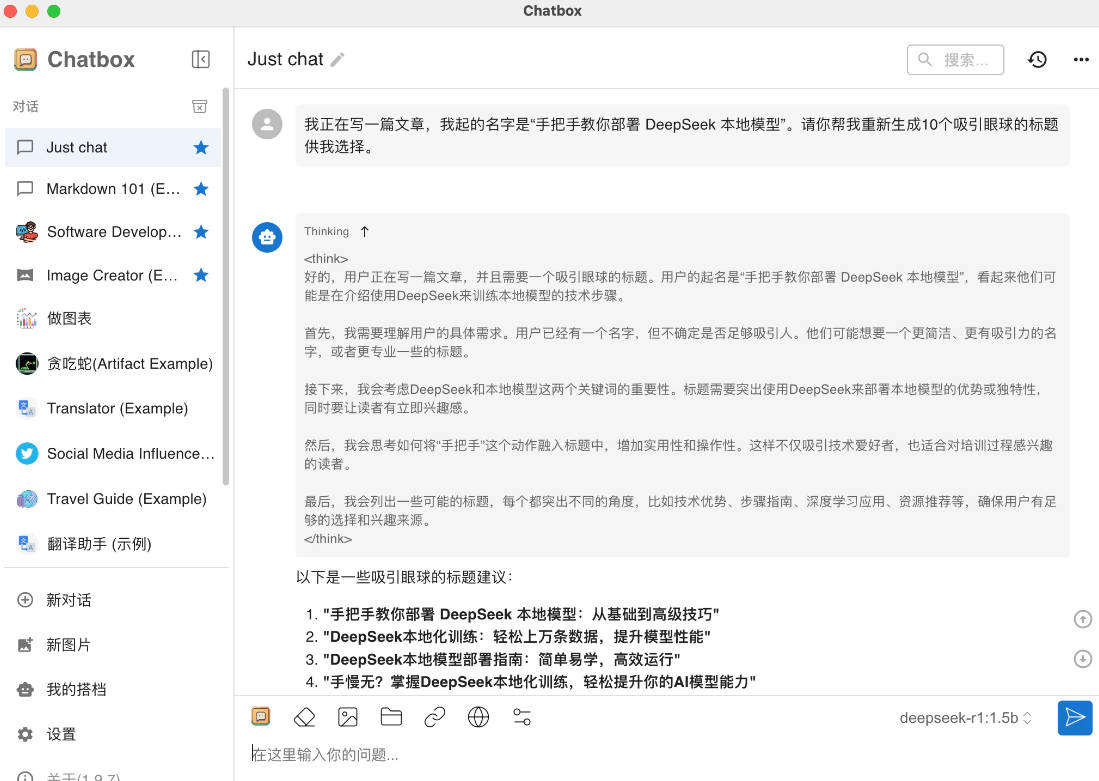

三、无需联网也能和DeepSeek畅快聊天

配置好DeepSeek本地模型之后,就可以实现在断网情况下自由问答了。

以上就是苹果电脑Macbook本地部署DeepSeek教程指南的全部内容了

1,Mac996站内所有应用软件及资料(除原创内容外)均来源于网络,如本站的内容对您的权利造成了影响,请与我们联系,我们会在第一时间进行修改或删除。

2,本站相关软件资源,仅供研究和学习使用,请在下载后24小时内删除。日常使用及商业用途的,请务必支持和购买正版。

3,本站赞助全凭自愿,您的赞助行为仅仅是出于对mac996的喜爱和支持,赞助将被用来提高网站的访问体验,而非购买资源。

4,如有问题/建议可加QQ群反馈,群号:958611112

5,本站统一解压密码:mac996.com

Mac996 » 苹果电脑Macbook/Mac mini本地快速部署DeepSeek指南